На этой неделе социальные сети, особенно в Германии и Венгрии, заполонили видео с плачущим "украинским призывником". Однако, судя по всему, ролик был создан с помощью ИИ-инструмента Sora для генерации видео от OpenAI.

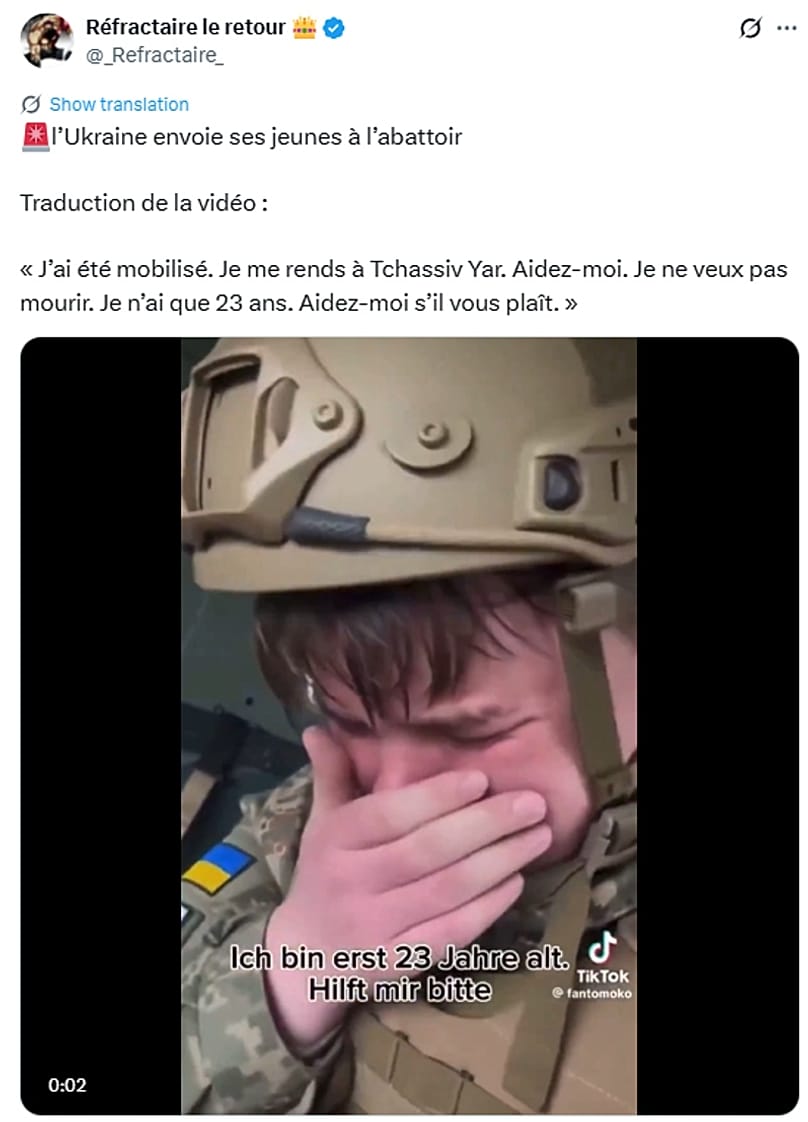

В социальных сетях распространяется короткое видео, на котором молодой человек, якобы отправленный на передовую украинский призывник, просит о помощи и плачет.

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

Видео, в котором молодой человек произносит фразу: "Я не хочу умирать, мне всего 23", набрало сотни тысяч просмотров в разных странах Европы, где оно сопровождалось субтитрами на венгерском, немецком и английском языках.

Только одна венгерская версия ролика собрала 1,8 миллиона просмотров. Команда Euronews по проверке фактов The Cube обнаружила еще несколько случаев повторного распространения видео с субтитрами на французском, испанском, греческом, турецком и даже японском языках.

В сопровождающих видео сообщениях утверждается, что солдата насильно отправили на фронт, а в сообщениях на немецком и французском языках подчеркивается, что Украина и другие европейские страны виноваты в том, что молодые украинцы едут на фронт.

"Украина отправляет своих молодых людей на бойню", - говорится в одном из французских аккаунтов.

Однако есть несколько признаков того, что видео является подделкой и, скорее всего, было создано с помощью искусственного интеллекта.

Поиск по распознаванию лиц, проведенный нашей командой, показывает, что человек из видео очень похож на российского стримера из Санкт-Петербурга.

Согласно заявлению Центра противодействия дезинформации Украины, "лицо, представленное на видео, принадлежит гражданину России, а не Украины".

На видео предполагаемый призывник говорит: "Меня мобилизовали. Я еду в Часов Яр". Украинские эксперты сообщили The Cube, что произношение названия города Часов Яр звучит неестественно и не соответствует украинской речи, что вызывает сомнения в подлинности видео.

Кроме того призывной возраст в Украине сейчас от 25 до 60 лет. Он был снижен с 27 до 25 лет в апреле прошлого года, чтобы увеличить численность войск на фоне полномасштабного вторжения России, которое продолжается уже четвертый год. Те, кому еще не исполнилось 25 лет, могут записаться только добровольно.

Видео появилось в тот момент, когда призыв в армию в Украине стал горячей темой для обсуждения. В феврале Украина ввела годичный военный контракт для 18-24-летних молодых людей. В апреле заместитель главы администрации президента Павел Палиса заявил, что только несколько сотен украинцев этого возраста подписали соглашение о прохождении службы.

Создано с помощью инструмента Sora

Проведя обратный поиск изображений, видео можно найти в удаленном аккаунте в TikTok, где были десятки видеороликов с "украинскими призывниками, попавшими в беду".

На некоторых из них есть водяной знак Sora, инструмента искусственного интеллекта OpenAI для преобразования текста в видео. На одном из видео мужчина, представляющийся украинским призывником, плачет кровавыми слезами.

По словам Джорджи Патрини, генерального директора и соучредителя компании Sensity AI, которая занимается поиском и мониторингом синтетических видеороликов, созданных ИИ, их технология показывает, что видео из этого аккаунта были созданы с помощью Sora, а водяной знак был удален после обработки.

Приложение, которое недавно стало доступно для пользователей Android в некоторых странах, позволяет пользователям создавать реалистичные видеоролики с использованием своего лица при условии, что они дают на это разрешение приложению.

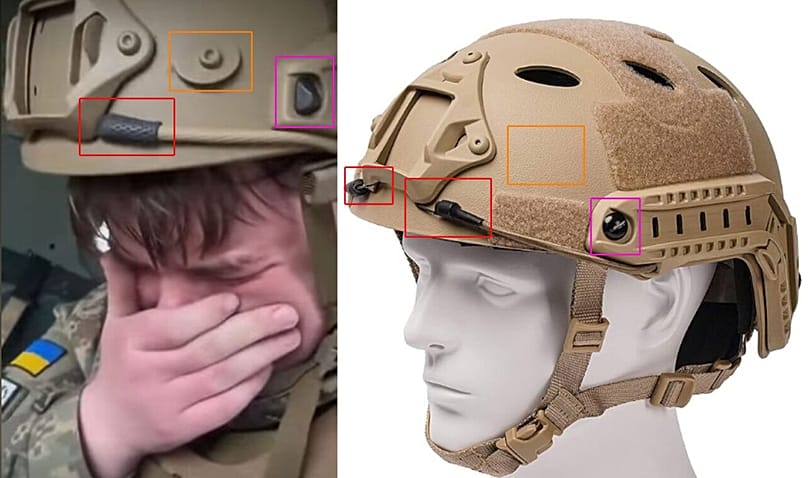

По словам Патрини, шлем, надетый на солдата в вирусном ролике, имеет несколько "несоответствий по сравнению с реальным военным снаряжением".

Боковые направляющие для аксессуаров и расположение винтов, как показано Sensity ниже, отличаются от типичных военных моделей. Кроме того, шлем не имеет панелей на липучках.

Украинский военный, с которым проконсультировался The Cube, подтвердил, что кабель гарнитуры, проходящий вдоль шлема на видео, выглядит необычно и не соответствует типичному военному снаряжению.

В другом видео, опубликованном в удаленном аккаунте TikTok, Sensity обнаружил, что надпись на куртке солдата сделана не кириллицей, "а латинскими буквами, имеющими поверхностное сходство с кириллицей".

Детали, по которым можно понять, что видео - фальшивка, порой трудно распознать.

По словам главного операционного директора Sensity Франческо Кавалли, подобные видео, созданные с помощью инструментов ИИ, являются "дешевым и широкодоступным оружием для операций влияния".

"Теперь любому ясно, что они используются в широких масштабах для достижения стратегических целей в гибридной войне", - сказал он.

"Цель проста, но эффективна: сформировать международное мнение, деморализовать противника и размыть грань между реальностью и вымыслом", - подчеркнул Кавалли.