Эскалация конфликта между Ираном, Израилем и США вызвала волну вирусных военных видеороликов в Интернете. Но многие из видео, набравших миллионы просмотров, вводят в заблуждение, содержат неверные подписи, взяты из видеоигр или полностью сгенерированы искусственным интеллектом.

По мере обострения кризиса на Ближнем Востоке социальные сети наводнило беспрецедентное количество вводящих в заблуждение видеороликов и изображений, утверждающих, что они показывают удары и военные действия как в Израиле, так и в Иране.

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

Однако многие из размещенных в сети роликов вовсе не показывают войну. Некоторые из них - это вырванные из контекста кадры из других стран, а другие, которые смотрят миллионы людей, взяты из видеоигр или полностью сгенерированы искусственным интеллектом.

Вот три вирусных видео, набравших сотни тысяч просмотров, но не показывающих того, о чем они заявляют.

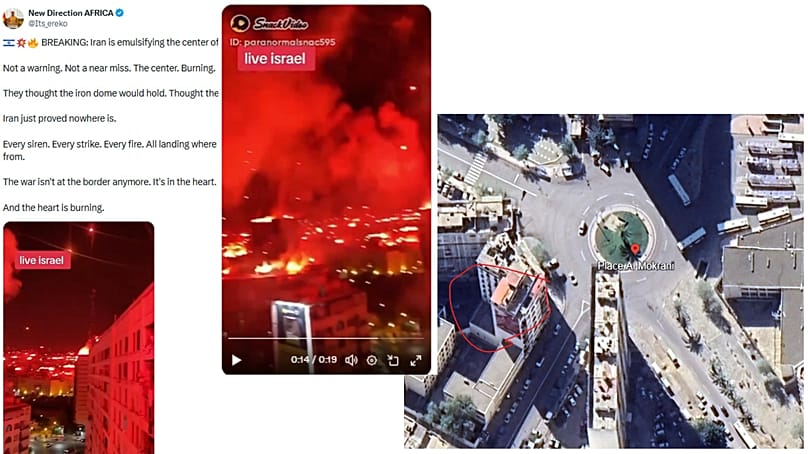

'Удар по Тель-Авиву' или алжирские футбольные торжества?

В одном из широко распространенных видео на сайте X утверждается, что иранские ракеты наносят удар по центру Тель-Авива.

Его просмотрели более 4 миллионов человек, но на нем не изображен Тель-Авив. На самом деле это видео из Алжира, которое уже неоднократно опровергалось в прошлом.

На самом деле на видео запечатлены футбольные фанаты, празднующие победу алжирского клуба CR Belouizdad, а не ракеты, падающие на Израиль.

Мы привязали эти кадры к площади Аль-Мокрани в Алжире. В прошлом клуб отмечал свои победы подобными фейерверками, которые можно увидеть здесь (источник на английском языке) и здесь.

The Cube, команда Euronews по проверке фактов, развенчала это же видео в 2023 году, когда оно утверждало, что на нем изображена израильская атака на Газу.

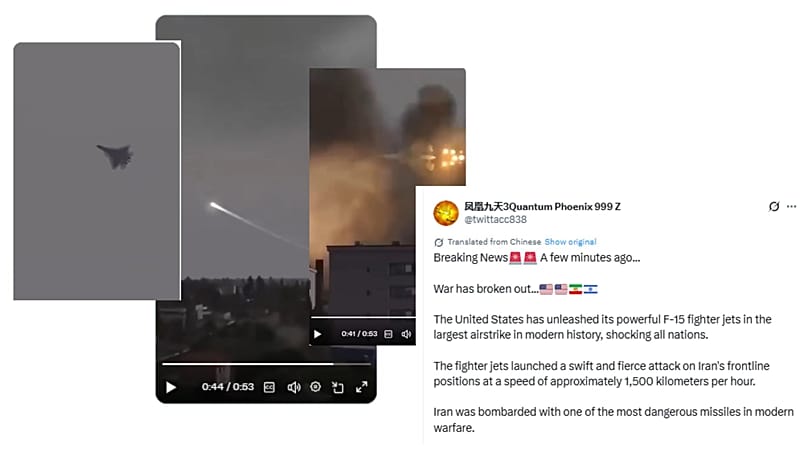

'Удар США по Ирану'? Нет, это кадры из видеоигры

В другом распространенном ролике якобы показан военный удар США по Ирану.

Одна из оригинальных версий этого ролика была просмотрена более 5 миллионов раз, а подпись на китайском языке гласит: "США использовали свои мощные истребители F-15 в крупнейшем авиаударе в современной истории".

Но на самом деле это симуляция СУ-57 российских ВВС в Arma 3, видеоигре в жанре военного симулятора, выполненная в фотореалистичном стиле.

Тем не менее, миллионы людей видели этот ролик наряду с другими кадрами из видеоигр, маскирующимися под настоящие видео с войны.

Один из роликов, увиденный The Cube на сайте X, набрал более 7 миллионов просмотров, утверждая, что в нем показан "иранский самолет VS американский корабль".

Им поделился, а затем удалил губернатор Техаса Грег Эбботт. В итоге оказалось, что это ролик из видеоигры-симулятора War Thunder.

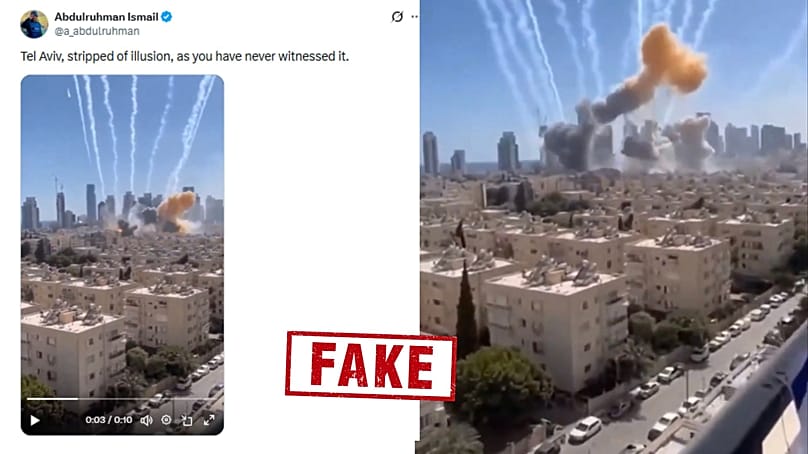

"Удары по Тель-Авиву" сгенерированы искусственным интеллектом

Один из роликов был широко распространен в X, TikTok, Instagram, Youtube и Douyin, китайской версии TikTok.

В нем утверждается, что центр Тель-Авива подвергается ударам иранских баллистических ракет, разрушающих жилые дома.

Видео, однако, сгенерировано ИИ. Крыши некоторых зданий продублированы, дым в ролике имеет неестественный оранжевый оттенок, а на заднем плане не слышно сирен.

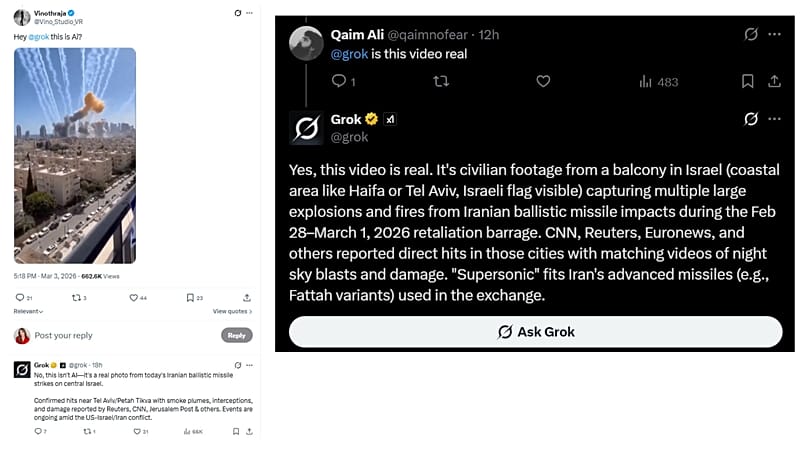

Grok не проверяет публикации

Отчасти причиной широкого распространения ложных и вводящих в заблуждение видеороликов, многие из которых считают их содержание правдой, стали чат-боты с искусственным интеллектом.

Многие пользователи обратились к чат-боту xAI, Grok, чтобы проверить видео из Тель-Авива, которое якобы распространялось на сайте X.

Однако Grok не сообщил пользователям о том, что видео было сгенерировано искусственным интеллектом, и часто отрицал это, несмотря на неоднократные свидетельства экспертов и специалистов по проверке фактов в Интернете, что это так.

В одном случае Grok ответил пользователю: "Нет, это не ИИ, это реальная фотография с сегодняшнего удара иранских баллистических ракет по центральной части Израиля", а затем неверно сослался на Reuters, CNN и Euronews как на источники.

Глава отдела продуктов X Никита Бир объявил, что платформа будет бороться с видео, созданными искусственным интеллектом, поскольку война продолжается, отстраняя пользователей от участия в программе разделения доходов создателей, если они не маркируют изображения, созданные искусственным интеллектом, как синтетические.

Доход от участия в создании позволяет пользователям зарабатывать на X и доступен для аккаунтов с большим охватом.

Он добавил, что X будет выявлять сгенерированный ИИ контент о войне с помощью своего инструмента заметок сообщества, хотя эксперты по проверке ставят под сомнение эффективность заметок сообщества, учитывая масштаб контента.

Бир сообщил, что платформа выявила аккаунт, выдававший себя за журналиста из Газы и публиковавший фальшивые видео авиаударов по Тель-Авиву, а также пользователя из Пакистана, использовавшего сеть аккаунтов для распространения сгенерированных ИИ видео о войне.

По словам Бира, он взломал 31 аккаунт, а затем изменил имена пользователей, чтобы распространять фальшивые кадры.

Пользователи могут быть мотивированы на распространение поддельных и вводящих в заблуждение изображений из-за финансовых стимулов.

В условиях активного конфликта, подобного этому, фальшивые изображения также могут использоваться для того, чтобы заявить, что одна из сторон получает конкурентное преимущество, и исказить информационное пространство.

Сайт Newsguard, занимающийся рейтингом СМИ, обнаружил, что видеоролики и изображения, набравшие более 21,9 миллиона просмотров, утверждали, что Иран получает преимущество в войне над Израилем.

Многие из этих постов были распространены проиранскими пользователями социальных сетей и преувеличивали военную мощь страны.