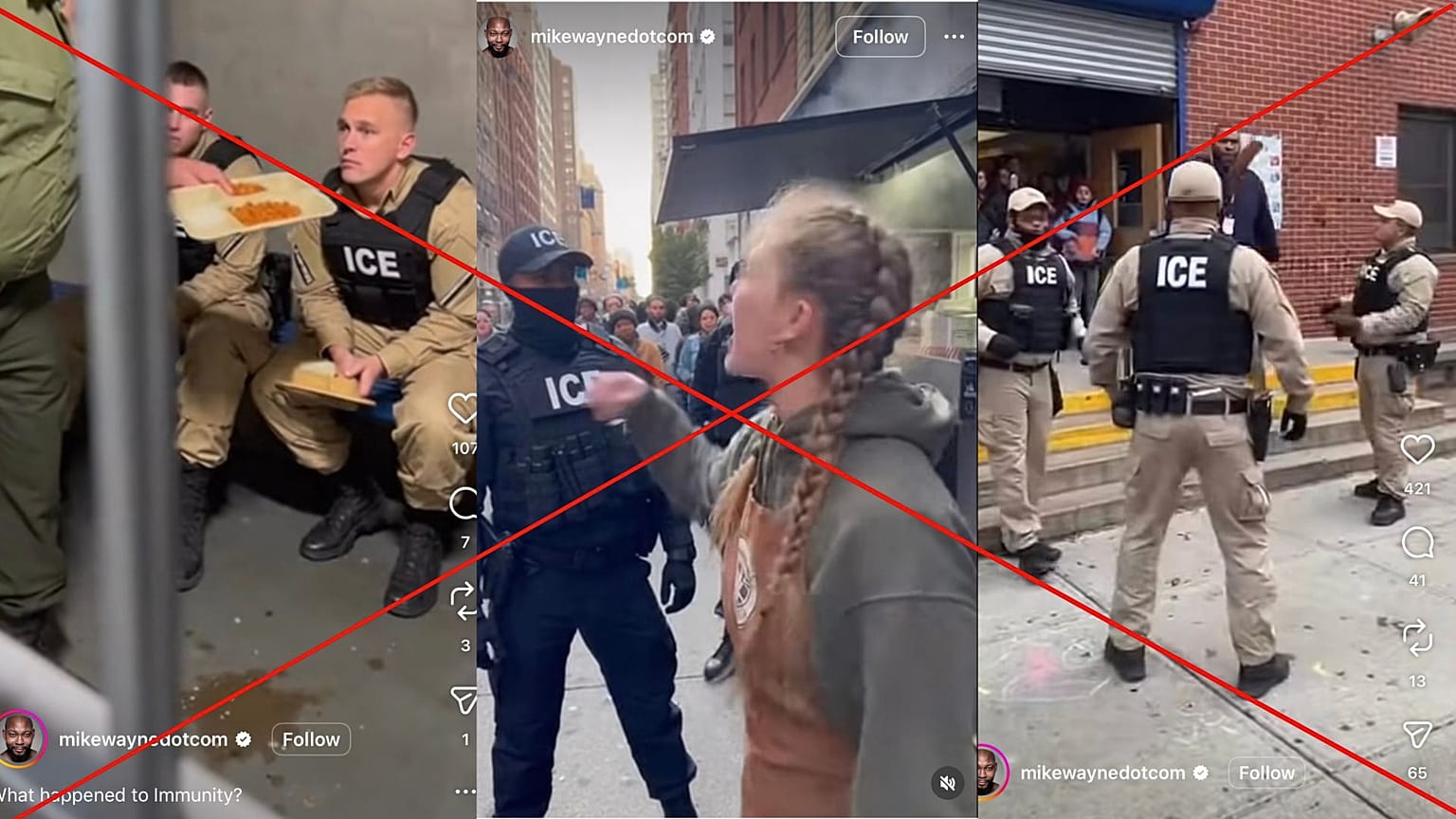

Около 200 роликов ICE, созданных искусственным интеллектом, набрали миллионы просмотров в социальных сетях, согласно данным, предоставленным The Cube.

Немецкая общественная телекомпания ZDF в конце февраля отозвала корреспондента из США после того, как в репортаже об агентах иммиграционной и таможенной службы США (ICE) появился ролик, сгенерированный искусственным интеллектом.

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

РЕКЛАМА

Телекомпания извинилась за использование ролика, в котором дети прижимаются к матери, когда ее арестовывают агенты ICE. На видео был водяной знак Sora - явное указание на то, что оно было создано с помощью видеоинструмента OpenAI.

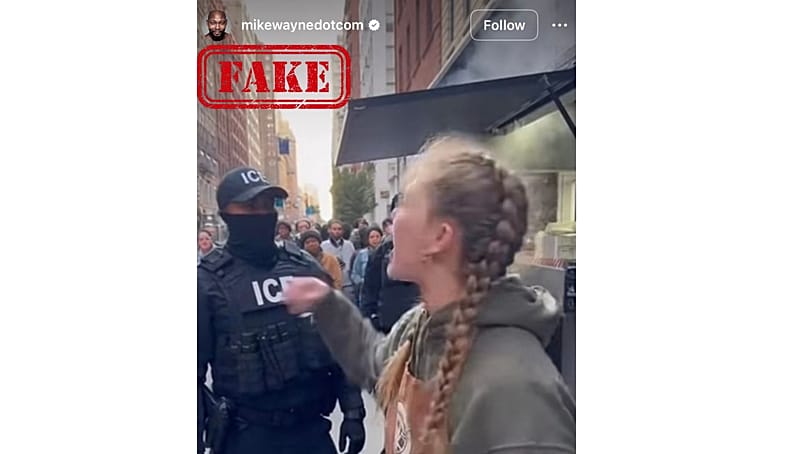

The Cube, команда Euronews по проверке фактов, обнаружила, что это видео - одно из тысяч сгенерированных ИИ роликов с агентами ICE, которые наводнили социальные сети. Многие клипы без четкой маркировки набирают миллионы просмотров.

Последовательная модель

Данные, которыми поделилась с The Cube компания TruthScan, занимающаяся обнаружением ИИ, показывают более 200 коротких роликов, в которых агенты ICE преследуются учителями, дерутся в барах и арестовываются полицией Нью-Йорка (NYPD) в метро.

Компания TruthScan заявила, что собрала более 200 видеороликов с одного аккаунта в Instagram. Видеоролики короткие, драматичные и эмоционально насыщенные.

The Cube обнаружил, что аккаунт по-прежнему массово публикует сгенерированные ИИ ролики с ICE, причем некоторые набирают тысячи, а другие - миллионы просмотров.

Есть разные признаки того, что видео не настоящие: в одном из примеров дым поднимается сквозь твердую поверхность во время стычки между агентом ICE и работником кафе - тонкий признак того, что ролик создан с помощью ИИ.

По данным TruthScan, каждое видео длится ровно 10 или 15 секунд, что позволяет предположить, что они были созданы с помощью видеомодели Sora 2 от OpenAI, которая предлагает пользователям 10- или 15-секундные видеоролики.

В отличие от многих сгенерированных ИИ видео, содержащих водяной знак, большинство этих роликов ICE не содержат его.

Аналогичным образом, в ноябре прошлого года 404 Media сообщили, что сгенерированные искусственным интеллектом ролики с агентами ICE, созданные с помощью аккаунта в Facebook, стали вирусными (источник на английском языке): только один из них собрал 4 миллиона просмотров. С тех пор видеоролики были удалены.

ИИ как инструмент влияния на общественное мнение

Эксперты говорят, что риск не ограничивается отдельными роликами с неправильной маркировкой, но и более широким распространением фальшивого контента по чувствительным политическим вопросам, что может подорвать общественное доверие.

"Существует значительный риск коллективной реакции на действия правоохранительных органов, как негативной, так и позитивной", - говорит Ари Абельсон, соучредитель компании OpenOrigins, занимающейся выявлением фальшивок в СМИ.

"Это беспокоит правоохранительные органы, которые хотят сохранить доверие, но это также важно для институтов, которые привлекают их к ответственности, когда они переступают границы", - сказал Абельсон изданию The Cube.

Как и в случае с ZDF, созданный ИИ контент ICE не ограничивается анонимными аккаунтами.

В январе Белый дом разместил измененное в цифровом формате снимок активистки и адвоката Некимы Леви-Армстронг после ее ареста на акции протеста против действий ICE в Миннесоте.

Анализ показал, что на измененном снимке Армстронг изображена более темнокожей и заметно рыдающей по сравнению с оригинальным изображением.

Белый дом ответил на вопросы о манипуляциях с изображением сообщением заместителя директора по коммуникациям Каэлана Дорра, в котором говорилось: "Еще раз обращаюсь к людям, которые чувствуют необходимость рефлекторно защищать виновных в чудовищных преступлениях в нашей стране, и сообщаю вам следующее: Исполнение закона будет продолжаться. Мемы будут продолжаться".

Армстронг сказала, что была в ужасе от измененного снимка.

По словам Абельсона, опасения возникают, если отсутствуют маркировки, которые бы ясно указывали на то, что контент является подделкой.

"Политические карикатуры всегда использовались в политике, и эти (снимки) используются очень похожим образом", - сказал он. "Ключевое различие заключается в том, насколько гиперреалистичными становятся видео".

"Социальные и информационные пространства требуют одного: возможности доказать, что фото и видео реальны, чтобы мы могли наслаждаться подделками как выдумками и ощущать серьезность реальных событий", - добавил он.